Veranstaltungen von und mit dem Kompetenzzentrum Öffentliche IT (ÖFIT)

FOKUS-Labtalk »Voneinander lernen – Digitalisierung im bundesdeutschen Ländervergleich«

Dienstag, 27.01.2026, Online-Veranstaltung. Im Labtalk diskutieren Vertreter:innen aus Wissenschaft und Verwaltung die Ergebnisse der neuen Ländersteckbriefe in den Themenfeldern Digitale Verwaltung, Digitales Leben und Infrastruktur – und die Chancen und Herausforderungen, die sich daraus ergeben.

2. Konferenz »Public Data – besser mit Behördendaten umgehen«

Donnerstag, 25.09.2025, Fraunhofer Institut FOKUS, Berlin. Hochwertige, leicht verfügbare Daten sind die Basis für die Modernisierung der Verwaltung: Nur aktuelle, strukturierte Informationen ermöglichen digitale, teilweise automatisierte Prozesse und wirkungsorientierte Steuerung. Diese Themen diskutieren wir in der zweiten Auflage der Konferenz »Public Data – besser mit Behördendaten umgehen«. Eingeladen sind bundesweit Führungskräfte aus Politik und Verwaltung an Schnittstellen zu Wirtschaft, Forschung und Zivilgesellschaft.

PIAZZA 2025: Neue Ideen für die Digitalisierung von Staat und Gesellschaft

Konferenzreihe PIAZZA, 06.11.2025, Online-Veranstaltung. Am 6. November 2025 fand die PIAZZA-Konferenz für digitale Verwaltung & Gesellschaft zum fünften Mal statt. Die rund 100 Teilnehmer:innen tauschten sich in acht Workshops zu kritischen Fragen der Digitalisierung von Staat und Gesellschaft aus.

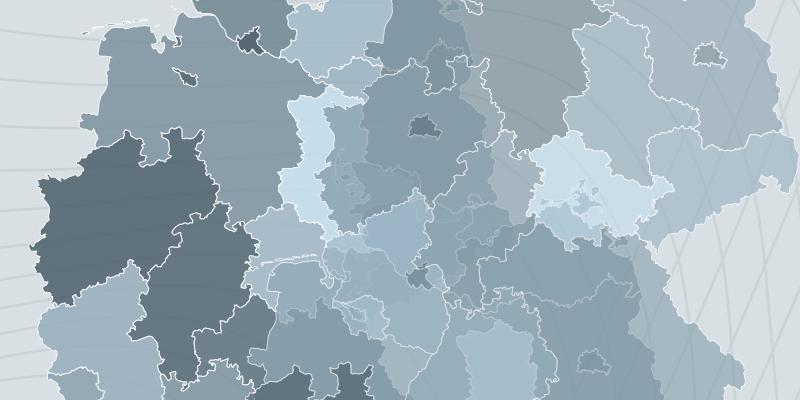

Vorstellung des Deutschland-Index der Digitalisierung 2025: Viele Wege, ein Ziel

Wie steht es um die Digitalisierung in den deutschen Bundesländern? Wie entwickeln sich Verwaltung, Infrastruktur und Gesellschaft? Das Kompetenzzentrum Öffentliche IT am Fraunhofer-Institut FOKUS stellte den Deutschland-Index der Digitalisierung 2025 auf dem 11. Zukunftskongress Staat & Verwaltung in Berlin vor. Vertreter:innen aus Bund, Ländern und dem Deutschen Städtetag diskutierten, wie digitale Verwaltungsleistungen flächendeckend verfügbar gemacht und ihre Nutzung gezielt vorangetrieben werden kann.

unREFORMIERBAR: Impulse für die Staatsmodernisierung

Montag, 17.03.2025, 15:30-20:30 Uhr, Fraunhofer FOKUS, Auditorium 1, Kaiserin-Augusta-Allee 31, 10589 Berlin. Auf die künftige Bundesregierung kommen große Aufgaben zu. Wie wird der Staat leistungsfähiger, um Vertrauen in die Demokratie zurückzugewinnen? Wie kann die Gesetzgebung als gestaltende Kraft helfen, die gesellschaftlichen Herausforderungen zu meistern? Und wie muss die entsprechende Governance aussehen, um die digitale Transformation von Staat und Gesellschaft zu steuern? Kurz nach der Bundestagswahl wollen wir die Gelegenheit nutzen, um der Politik wichtige Impulse und notwendige Reformvorschläge mit auf den Weg zu geben

PIAZZA 2024: Für digitale Verwaltung & Gesellschaft

Konferenzreihe PIAZZA, 14.11.2024, Online-Veranstaltung. Am 14. November 2024 fand die PIAZZA-Konferenz für digitale Verwaltung & Gesellschaft zum vierten Mal statt. Die rund 100 Teilnehmer:innen tauschten sich in acht Workshops zu kritischen Fragen der Digitalisierung von Staat und Gesellschaft aus. Die Träger der PIAZZA – ÖFIT, NExT e.V., Gesellschaft für Informatik und Open Knowledge Foundation – bedanken sich für das erneute große Interesse und die stetig wachsende PIAZZA-Community.

Konferenz »Public Data – besser mit Behördendaten umgehen«

Donnerstag, 19.09.2024, Fraunhofer Institut FOKUS, Berlin. Nur mit hochwertigen und einfach verfügbaren Daten kann die sinnvolle Digitalisierung und, wo angemessen, Automatisierung von Prozessen in der öffentlichen Verwaltung gelingen. In den sieben Sessions geht es unter anderem um Fragen zu Datenstrategien, -infrastrukturen und Data Literacy.

Ehrenamt 2.0: Wie das THW digitale Technologien nutzt

Freitag, 07.06.2024, 14:00 bis 15:15 Uhr, Online-Veranstaltung. Welche Möglichkeiten gibt es, sich ehrenamtlich im THW zu engagieren, und welche Rolle spielt die Digitalisierung dabei? Zu diesem Thema begrüßte ÖFIT anlässlich des Digitaltags 2024 Staatssekretärin Juliane Seifert (BMI), die Präsidentin des THW Sabine Lackner sowie weitere Vertreter:innen von THW und ÖFIT zu einer gemeinsam ausgerichteten Diskussionsveranstaltung.

Zukunft der Datenlabore - Wie gelingt datengestützte Politikgestaltung?

Mittwoch, 06.03.2024, 9:00 bis 11:00 Uhr, Online-Veranstaltung. Vor dem Hintergrund der anstehenden haushaltspolitischen Entscheidung über ihre Zukunft zielt die Veranstaltung darauf ab, Einblicke in die Arbeit der Datenlabore des Bundes zu gewähren und ihre Rolle bei der Gestaltung datengestützter Politik zu diskutieren. Freuen Sie sich unter anderem auf Henriette Litta (Open Knowledge Foundation) und Frederik Blachetta (Datenlabor des BKAmts). Das Publikum ist eingeladen, sich an der Diskussion zu beteiligen.